A startup de inteligência artificial OpenAI, conhecida pelo desenvolvimento do ChatGPT, expressou apoio a um novo projeto de lei na Califórnia que visa a identificação de conteúdo gerado por IA.

O projeto de lei AB 3211, que foi discutido no final de agosto, propõe a obrigatoriedade de marcas d'água nos metadados de fotos, vídeos e clipes de áudio criados por inteligência artificial, como uma forma de diferenciar esse conteúdo do produzido por humanos.

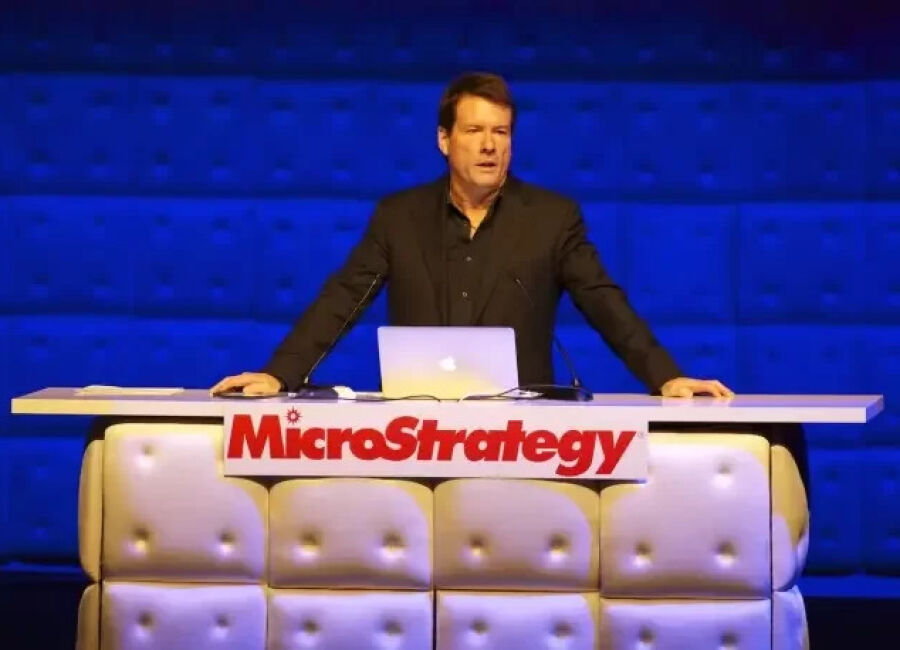

Jason Kwon, diretor de estratégia da OpenAI, manifestou o apoio da empresa ao projeto, destacando que a identificação clara do conteúdo gerado por IA ajudaria os usuários a evitarem confusões.

"Novas tecnologias e padrões podem ajudar as pessoas a entenderem a origem do conteúdo que encontram on-line e evitar confusão entre conteúdo gerado por humanos e conteúdo fotorrealista gerado por IA", disse Kwon em carta revisada pela Reuters.

Além da OpenAI, outras grandes empresas de tecnologia como Microsoft e Adobe também apoiam o AB 3211. No entanto, a OpenAI havia se oposto a outro projeto de lei relacionado à IA, o SB 1047, que exigiria testes de segurança para modelos de IA.